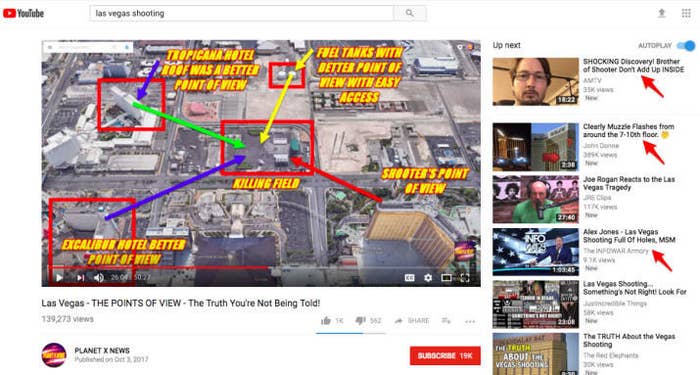

2017年10月のラスベガス銃乱射事件が起きてから数時間後、BuzzFeedのライアン・ブロデリックは奇妙なことに気付いた。当初被害者とされ、その後そうでないと訂正された男性の情報をGoogleで探したところ、4chan発の偽情報へリンクされたGoogleニュースが検索結果に現れたのだ。4chanは悪名高い匿名掲示板で、この事件を政治問題化させようと複数の参加者が大っぴらに活動していた。その2時間後、銃撃犯は「反ファシズム主義者」を自称する組織の構成員であるという誤った主張の投稿が、Facebookで拡散し始めていることを見つけた。さらに1時間ほど経過すると、YouTubeでざっと検索しただけで、同様の主張をする陰謀論ビデオが大量に見つかるようになった。これらのビデオは例外なく、被害者たちを政治的な目的のもと演技を行った「クライシス・アクター」と断定している。彼はこうした事例を見つける度に自身のTwitterで発信した。

Also, apparently Google is putting 4chan threads in their top story unit now? So, the number one hit for his name i… https://t.co/CuQx4w7dhn

Geary Danleyさん(訳注:銃撃犯であると根拠なく決めつけられた人物)とその家族は物騒な左翼である、という話を作る活動が、今まさに4chanの少なくとも6個のスレッドで進行中だ。

Googleはこの4chanのスレッドをトップニュースに選んでいる。さらに、彼の名前を検索した結果のトップは政治問題を扱う「/pol/」のスレッドだ。

それから2日間、ジャーナリストや偽情報研究者たちは、フェイクニュースと陰謀論が惨劇によるショックの残るなかで広まる様子を、報告したりツイートしたりした。ニューヨーク・タイムズのジョン・ハーマン氏は、再生回数が数十万回もある陰謀論ビデオをYouTubeでいくつも見つけ、その多くが検索結果の上位に表示されている、とした。ファスト・カンパニーのカール・ワイズマン氏は、オルト・ライト(オルタナ右翼)系ブログや偽情報だらけのEnd Time Headlinesといったサイトからのニュースが、Facebookの「災害支援ハブ」(旧「災害時情報センター」)に表示されていることに気付いた。私はYouTubeのレコメンデーション・エンジンを調べ、陰謀論ビデオが検索アルゴリズムの力を借りてユーザーをどのように“罠に誘い込むのか”追いかけた。ハーマン氏とワイズマン氏は、見つけた事例をYouTubeとFacebookへ報告している。両社はいずれについても謝罪し、ニュースやビデオの内容に気付いていなかったと答え、改善を約束したうえで削除してくれた。

同じ事態が、銃乱射事件や惨劇のたびに繰り返されている。

ジャーナリストや研究者などは、YouTubeやFacebookのようなプラットフォームが自力で発見するよりもずっと早くに、軽く検索しただけで偽情報とフェイクニュースを見つけた。これと同じことが、銃乱射事件や惨劇のたびに繰り返されている。NYC Media Labでエクゼクティブ・ディレクターを務める研究者のジャスティン・ヘンドリックス氏は、11月のテキサス州サザーランド・スプリングス銃乱射事件が報道されてわずか数時間後に、Googleの「Popular on Twitter」(Twitterで話題)ウィジェット内で偽情報が飛び交っていた、と指摘した。共和党議員の乗った列車が1月に衝突事故を起こした直後も、デイリー・ビーストのベン・コリンズ氏がすぐにFacebookを調べたところ、数百万人のユーザーが読むとされる注目ニュース掲載コーナーは陰謀論で溢れてた。

Google's 'Popular On Twitter' news feature is a misinformation gutter. Search for Devin Patrick Kelley just now sur… https://t.co/8YxgZjljlv

Googleの「Twitterで話題」ニュース機能は、偽情報の掃き溜めだ。Devin Patrick Kelley(訳注:サザーランド・スプリングス事件の容疑者)を検索すると、今はこの4つの結果が表示される。

いずれのプラットフォームも、4カ月間に3件の全国ニュース速報レベルの事件で犯した失態を謝罪し、改善を約束した。そんな時に起きたのがフロリダ州パークランドのマージョリー・ストーンマン・ダグラス高校で銃乱射事件だった。改善の機会であったにもかかわらず、プラットフォームはまたもや失敗した。パークランド事件の発生直後に、大量の偽情報、ジャーナリストを騙ったトロール(荒らし)、バズっているFacebookの投稿、被害者を中傷したりクライシス・アクターだと断言したりするYouTubeの「人気」ビデオをまず特定したのは、Twitterで活動しているジャーナリストや研究者たちだった。こうした問題行動は、大多数が明らかに各プラットフォームのルール違反でありながら、いずれもYouTube、Facebook、Twitterが気付くよりはるかに早くジャーナリストなどの外部の人々によって発見された。ニューヨーク・タイムズのケビン・ルーズ氏は、昨今のTwitterを動かしている原動力について整理し、「技術系レポーターが2018年に実行する仕事の半分は、巨大企業のコンテンツを節度ある状態に直す無料奉仕になるだろう」と指摘した。

技術系の主要プラットフォームと偽情報に注目している人々は、この状況にすっかり落胆している。ほとんど知識を持たないニュース読者が最小限の労力で実行可能なことなのに、こうしたプラットフォームは失敗を繰り返す。数え切れないほど多くの記事、暴力的なコンテンツにリンクされたメール、バズるツイートがあっても、事態は変化しない。YouTubeで見られる憤慨するようなジョークや、Facebook上の陰謀論で使われる戦略は、アナログ時代に出回っていた偽情報とほとんど同じだ。例えば、クライシス・アクターに関する投稿やビデオは、何年も前から徐々に広められてきた偽情報の代表である。

この状況は今に始まったものではない。そして、プラットフォームは問題解決能力など持っていないことを、自ら繰り返し何度も何度も証明し続けている。多くの場合、プラットフォーム側は自分たちのサイトにそんなコンテンツがあると知って驚いたようだ。それだけでない。広報担当者の反応からも、失敗した際の返信メッセージをきちんと準備しておらず、不意を突かれたらしいことが分かる。

To give you an idea how ill-equipped Facebook and Google were at handling this issue yesterday: I got two conflicti… https://t.co/FhlMkd1NRf

話をFacebookに戻そう。一部の検索結果から「David Hogg」(訳注:パークランド乱射事件の生存者で、クライシス・アクターだと非難された人物)が外されたみたいだ。例えば「投稿」の所には表示されない。

この偽情報の投稿が今もシェアされているかどうか、判断しにくい。

ポンコツなFacebookとGoogleが昨日この問題(訳注:パークランド乱射事件)をどう扱ったか、お知らせしよう。Facebookの社員2人から(PR部門経由で)矛盾する説明を2件受けた。(訳注:Google傘下の)YouTubeは、数時間の時間差で説明を2件送ってきた。どちらも完全に不意を突かれたのだろう。

こうした状況から、YouTube、Google、Twitter、Facebookがまだ答えていない、単純だけれどドキッする疑問が浮かぶ。イノベーションを誇り、莫大な資金を持つ技術系企業に実行不可能なことが、なぜ特別な訓練を受けていない普通の人に対処できてしまうか。それどころか、でっち上げと偽情報から全国レベルの政治的問題がいくつも発生したのに、どうしてこんな問いかけが必要なのだろう。

これは誰もがすでに行っていること。だからこそ、今すぐにでも実行可能なはずだ。

Facebook、Google、YouTubeほど巨大なプラットフォームをバランスの取れた状態にする作業は、気が遠くなるほど複雑だ。YouTubeに投稿されるビデオの量は、1分間で数百時間分もある。Facebookには20億人のユーザーがいて、数千万あるグループとページで論争が起きている。コンテンツの適正化は、言論の自由および偏見に対して抱く正当な懸念と背中合わせだ。こうしたプラットフォームで見られる悪質なコンテンツの多様さに圧倒されてしまう。Facebook向けに外国の援助で作られる広告とフェイクニュース、Twitterでの過激なハラスメント、YouTubeに存在する家族ビデオを装った児童労働搾取ビデオ、など多種多様だ。プラットフォームの直面している課題は、非常に手強い。技術とポリシー、それにほぼ誰も納得のいく答えを出せない哲学的な問題が絡み合った難問である。

なお、プラットフォームは、こうした偽情報への対策を、速報されるニュースや事件に対して取り入れたいのだろうが、実際のところ両者は異なる。プラットフォームは、特定の事件に関する偽情報への対策に失敗し続けている。ところが、ブロデリック氏などが偽情報を見破るのに使った検索手法は、とてもシンプルなものだった。大抵の場合、銃撃犯や被害者のフルネームを検索するだけの作業で済む。

偽情報との戦いにおいて、巨大技術プラットフォームは厳しい苦戦を強いられている。そもそも、この戦いで有利な位置に立てる企業や組織があると考えにくい。世界中にあるGoogleやFacebook的な企業の収益性は驚くほど高く、世界でもトップクラスの賢い人材と優秀なエンジニアを雇っている。こうした企業は、金ばかり食う、クレージーに聞こえるようなアイデアに投資をしている。例えばGoogleには、「月へ打ち上げるロケットの船長」という肩書きの社員がおり、夢のようなアイデアの実現を目指すプロジェクトに取り組んでいる。ちなみに、この社員は自律走行する自動車の技術開発に携わっていて、成功を収めつつある。

もっとも、言うまでもなく、GoogleやFacebook、Twitterが、何十億人ものユーザーから投稿されるコンテンツをすべて監視することなど不可能だ。そんな対応を実際に要求する人もいない。しかし、ある日のニュースに関係する投稿のうち、どれを削除してどれを注目コンテンツとして取り上げるか整理する作業は、別の話だ。これは誰もがすでに行っていることで、すぐにでも実行可能だ。

それなのに、プラットフォームから依頼されて活動しているわけではないジャーナリストや研究者、関心を抱いている一般市民がノートPCで4chanに数回アクセスしただけで見つけられる情報に、これらプラットフォームはなぜ辿り着けないのだろう。おそらく、この問題は社外の人間が理解できないほど複雑だからなのだろう。そして、これはプラットフォーム各社がよく使う言い訳だ。コメントを求めたところ、Facebookは、人間とコンピュータによる適正化処理とユーザーからの報告で対応している、という回答を繰り返し、適正化には微妙な違いがあり、文脈の判断は難しい、と答えた。Twitterも、ユーザーからの報告とルール適用のための技術に頼っていると説明し、「文脈が鍵」という基準の影響を受けて発言保護に偏り過ぎた誤判断をしている、とした。YouTubeも、ルール違反の可能性があるコンテンツを機械学習システムで選び出してから、人間が確認する対応をしている、とした。さらに、そうしたコンテンツの「発見」要員は、大きな効果が得られないとの理由で配置していない、と回答した。

見えないというのは、きちんと見ていないからだ。

これらプラットフォームは、自分たちを信用してほしい、としている。「努力しているが、難しいことであり、一朝一夕には解決できない」というのだ。分かった、信用しよう。ただし、巨大な技術系企業の発見できない偽情報を、検索窓よりも高度なツールなど使わず見つけられるのだから、その理由は1つしかない。見えないのは、きちんと見ていないからだ。

例えば、大事件のニュースに対して外部の人がしているのと同じことを実行する専門部署を社内に設けるのは、そんなに難しいことだろうか。具体的には、検索結果の上位や注目の話題といった部分に表示される情報が、明らかに誤解を招く陰謀論的なコンテンツかどうか、調べて確認する作業を担う部署の設置だ。

絶対に間違いのない対策ではないものの、多少の改善にはなる。

この記事は英語から翻訳されました。翻訳:佐藤信彦 / 編集:BuzzFeed Japan